Многим людям может быть интересно, представляют ли машины угрозу миру, в котором мы живем, или они просто еще один инструмент в нашем стремлении к самосовершенствованию. Если вы думаете, что ИИ – это просто еще один инструмент, то можете быть удивлены, узнав, что по этому поводу думает Илон Маск:

“Величайший страх человечества заключается в том, что искусственный интеллект может захватить наши рабочие места, нашу экономику и наши правительства”.

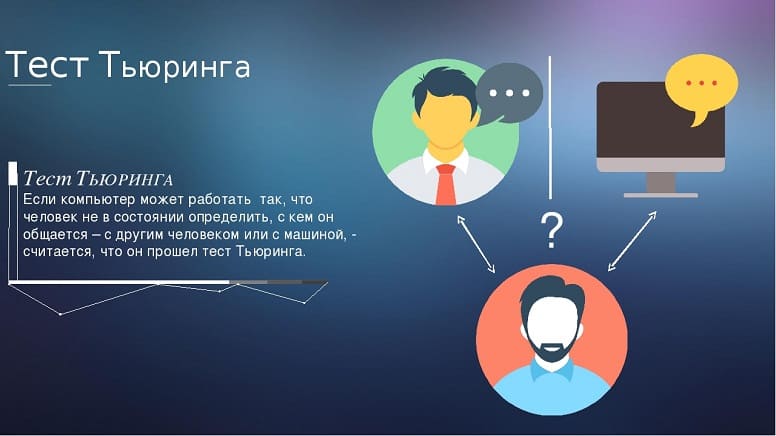

Но дело в том, что на самом деле Илон Маск не имеет никакого отношения к данному высказыванию. Этот подзаголовок был сгенерирован искусственным интеллектом под названием GPT-2. Выглядит довольно по-человечески, не так ли?

GPT-2 – это нейросеть, запущенная OpenAI (компания, основанная Илоном Маском), которая способна генерировать связный текст, используя минимум подсказок: введите заголовок, и она напишет историю, предоставьте ей первую строку стихотворения, и получите целую поэму.

Но большой прорыв произошел в этом году, когда OpenAI запустила следующее поколение GPT-2 под названием GPT-3 – инструмент настолько продвинутый, что легко разбирается в том, какие понятия соотносятся друг с другом и распознает любой контекст.

С архитектурной точки зрения GPT-3 – это вовсе не инновация: он просто использует хорошо известный подход, основанный на машинном обучении (искусственные нейронные сети) и получает данные из интернета. Настоящая инновация заключается в огромном количестве используемых параметров (175 миллиардов). Это самая большая языковая модель из когда-либо созданных, обученная на самом большом наборе данных любой языковой модели. Сравнительно, модель GPT-2 обучалась с помощью 125 миллионов параметров.

Нейросеть GPT-3, похоже, способна делать практически все: она может быть переводчиком, программистом, поэтом или автором бестселлеров, опираясь при этом всего на десяток обучающих примеров.

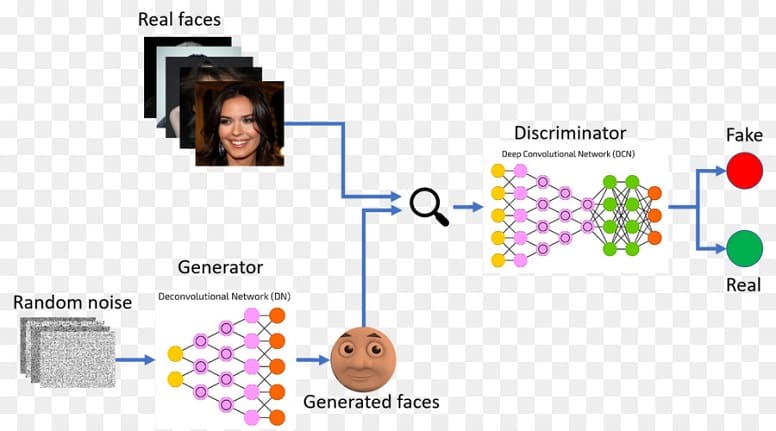

Нейросеть также способна работать с компьютерной графикой и создавать несуществующие интерьеры, объекты и даже портреты людей. Поддельные изображения создаются с помощью нейросети GAN, или генеративно-состязательной сети, использующей самообучающийся алгоритм. GAN – это инновация в ИИ, способная моделировать новые изображения, видео и даже голоса.

GAN состоит из двух нейронных сетей – генеративной модели, которая старается отличить правильные образцы от неправильных и дискриминативной модели, которая имеет противоположные цели – она создает и отбраковывает образцы. Как они работают вместе?

Генеративная сеть генерирует истинные и поддельные выборки данных, чтобы ввести дискриминативную сеть в заблуждение, в то время как дискриминативная сеть пытается определить разницу между поддельными и реальными данными, оценивая их на подлинность.

Путем итерации этого цикла цель состоит в том, чтобы две сети становились все лучше и лучше до тех пор, пока не будет создан генератор, выдающий реалистичные результаты (генерирующий правдоподобные примеры). Поскольку дискриминативная сеть “конкурирует” с генеративной, система в целом описывается как “состязательная”.

Все это может шокировать, но нет причин бояться этих технологий (по крайней мере, пока). Ни один из приведенных примеров не является магическим – это результаты научных исследований, которые (опять же пока) можно объяснить и понять. Несмотря на то, что некоторые действия ИИ могут выглядеть “разумными”, они все еще очень далеки от любого процесса человеческого познания.

К примеру, GPT-3 не обладает внутренним представлением о том, что на самом деле означают слова, и не обладает способностью рассуждать абстрактно. Кроме того, он может терять связность в достаточно длинных отрывках и противоречить самому себе. GPT-3 – пока не угроза человечеству.